Activer le mode zen

Ressource au format PDF

Classification

Quelques applications de l'intelligence artificielle - L'IA est en train de révolutionner la plupart des domaines scientifiques et industriels, voici quelques exemples

L'intelligence artificielle : introduction et applications en physique (3/3)

05/07/2021

Résumé

Vous êtes-vous déjà demandé s'il était possible de créer sa propre IA ? Et de l'utiliser dans ses recherches en physique ou dans l'industrie ? C'est ce que nous allons voir dans cette série de 3 articles : L'intelligence artificielle : introduction et applications en physique.

Dans ce dernier article nous présentons des utilisations de l'intelligence artificielle dans le domaine de la physique et dans l'industrie.

Colin Bernet est chargé de recherche au CNRS, créateur du blog https://thedatafrog.com, et cofondateur de https://cynapps.ai.

Table des matières

Série de 3 articles : L'intelligence artificielle : introduction et applications en physique

Article précédents :

1. Quelques applications en physique

L’intelligence artificielle est maintenant utilisée dans la plupart des domaines scientifiques, où elle apporte souvent de belles améliorations par rapport aux approches plus traditionnelles.

Et parfois, elle est à l’origine de véritables révolutions. C’est par exemple le cas de AlphaFold [1], qui a permis de résoudre en 2020 l’un des problèmes majeurs en biologie : prédire la configuration spatiale d’une protéine complexe à partir de sa formule chimique.

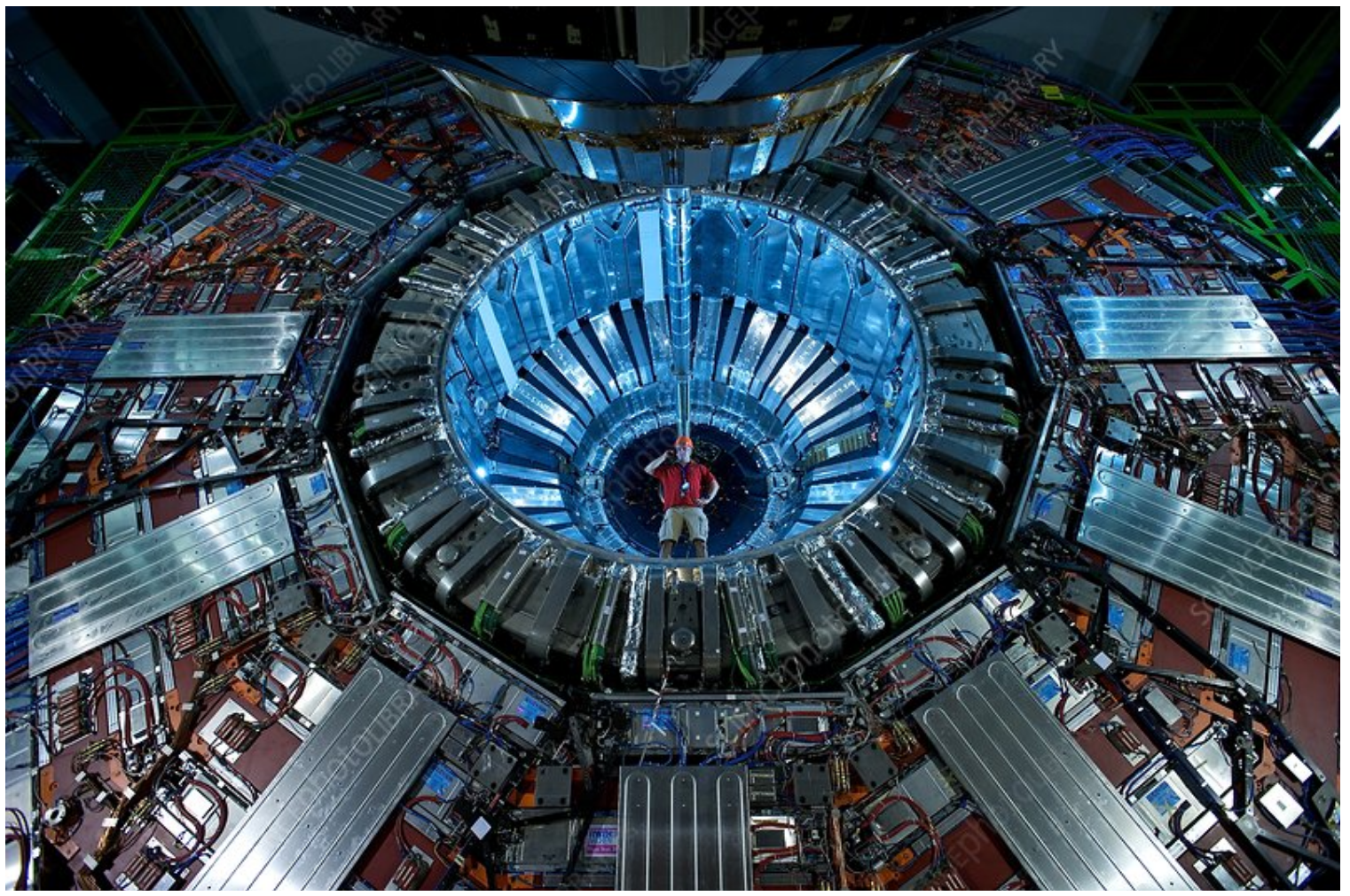

Intéressons-nous maintenant à la physique des particules. Le détecteur CMS, installé sur le Grand Collisionneur de Hadrons (LHC) au CERN, analyse 40 millions de collisions proton-proton par seconde, figure 1.

L’immense majorité de ces collisions ne présente aucun intérêt. Il faut donc pouvoir les rejeter tout en conservant les collisions intéressantes comme celles où un boson de Higgs a été produit.

Pour cela, des programmes informatiques analysent les particules créées dans la collision. Dans l’exemple suivant, figure 2, la collision donne lieu à deux jets de particules ainsi qu’un boson de Higgs. Celui-ci, très instable, se désintègre immédiatement en une paire de τ (τ1 et τ2), qui eux-mêmes se désintègrent en particules stables. Ce sont les seules qui pourront atteindre le détecteur et y être observées.

Le boson de Higgs n’est donc visible qu’à travers ses produits de désintégration.

Le premier problème est d’identifier correctement les deux τ provenant du boson de Higgs, vis à vis des jets. Pour cela, CMS utilise un réseau de neurones appelé DeepTau, dont le rôle est de classifier les τ et les jets.

DeepTau part de groupes de particules évoluant dans une même direction (soit des jets, soit des τ). Pour chaque groupe, on lui fournit des informations globales sur le groupe (quantité de mouvement totale et masse du groupe, nombre de particules, etc). On lui donne aussi une image de la localisation des particules à l’intérieur du groupe. Les pixels de cette image sont définis sur un angle solide centré sur la direction du groupe de particules. Et dans chaque pixel, on enregistre la quantité d’énergie portée par toutes les particules contenues dans le pixel.

DeepTau comporte une partie convolutionnelle chargée d’analyser l’image de la structure en particules du groupe, et il combine ensuite les résultats de cette partie convolutionnelle avec les informations globales.

Il est entraîné grâce à des données provenant de la simulation du détecteur CMS. On simule un échantillon de jets et de τ, qui donnent lieu à des groupes de particules. Grâce à la simulation, on sait donc précisément si un groupe donné correspond à un jet ou à un τ. On donne ensuite ces groupes étiquetés à DeepTau, qui apprend à classifier les τ et les jets en utilisant uniquement les informations globales et l’image de la structure des groupes.

Le deuxième problème est l’estimation de la masse du boson de Higgs. Une fois les τ identifiés, on pourrait en principe mesurer leur énergie et leur direction pour en déduire la masse du boson de Higgs qui leur a donné naissance, grâce à un calcul de relativité restreinte.

Ce calcul, qui ne sera pas détaillé ici, est basé sur la correspondance entre énergie et masse, E = mc2. Plus la masse de la particule mère est élevée, plus l’énergie de ses produits de désintégration est grande.

Cependant, la production d’un τ est toujours accompagnée de celle d’un neutrino τ, une particule invisible, qui traverse CMS sans être détectée. Ces neutrinos emportent donc une partie de l’énergie résultant de la désintégration du boson de Higgs. Par conséquent, la masse calculée pour le boson de Higgs apparaît trop faible.

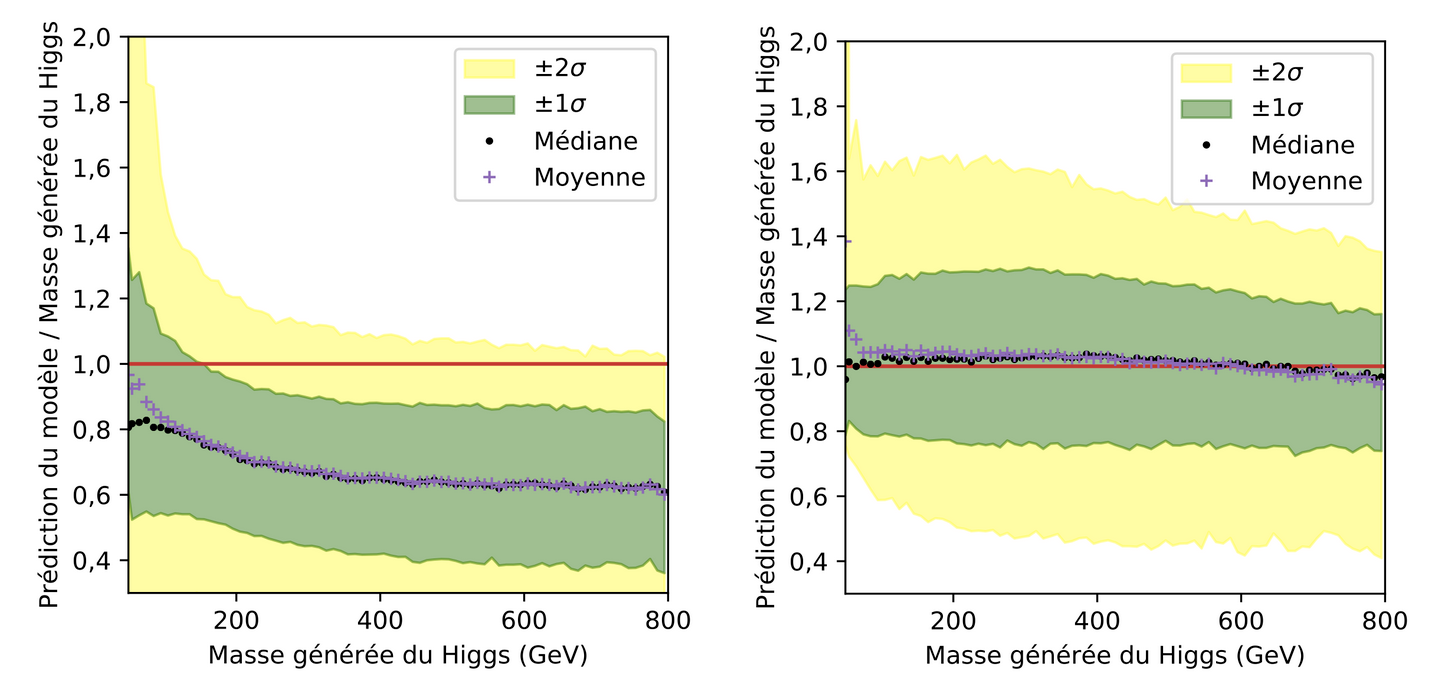

La figure 3 à gauche présente le rapport entre masse calculée et masse réelle, en fonction de la masse réelle, pour des bosons de Higgs simulés avec une masse comprise entre 50 et 800 GeV. Si la masse était parfaitement reconstruite, le rapport serait centré sur un. On voit donc effectivement que le calcul sous-estime fortement la masse réelle.

La figure 3 à droite montre les résultats obtenus avec un réseau de neurones entraîné à prédire la masse du boson de Higgs à partir de l’ensemble des informations détectées. Cette estimation de la masse est beaucoup plus précise [2].

2. Cas d'usage industriels

Il existe de nombreuses applications de l’intelligence artificielle dans l’industrie.

Pour la maintenance, on peut collecter en temps réel les données de différents capteurs placés sur une machine, au moyen d’un système IoT (Internet des objets). Il peut s’agir de capteurs de température, de pression, de vibrations, ou de consommation électrique, etc.

Les données de ces capteurs sont généralement traitées par des réseaux de neurones similaires à ceux utilisés dans le traitement du langage.

On peut par exemple faire de la maintenance prédictive, qui consiste à prédire au cours du temps la probabilité que la machine tombe prochainement en panne. La difficulté principale de ce type d’approche est que l’on ne dispose généralement pas de suffisamment de données pour l'entraînement de l’IA. En effet, les cas de panne sont rares, et c’est tout particulièrement le cas pour les machines les plus critiques, qui sont aussi les plus fiables.

La détection d’anomalie est une solution à ce problème. Dans ce cas, on choisit une période durant laquelle la machine fonctionne parfaitement du point de vue d’un utilisateur expert. Sur les données de cette période, une IA est entraînée à prédire, à partir d’un court intervalle de temps de la période considérée, les futures valeurs de chacun des senseurs juste après cet intervalle.

On laisse ensuite l’IA analyser au cours du temps les données des senseurs. Lorsque les données divergent des prédictions de l’IA, c’est le signe d’une anomalie, et on peut alors alerter automatiquement les opérateurs de maintenance.

Un autre domaine d’application est le contrôle qualité lors de la production.

Ainsi, au LMA, le laboratoire des matériaux avancés de l’IP2I de Lyon [3], on construit des miroirs de très haute qualité, notamment pour les interféromètres de Michelson dédiés à l’observation des ondes gravitationnelles, figure 4.

Ces miroirs doivent être absolument parfaits. Ils sont donc scrutés au moyen d’un micromap, un dispositif permettant de photographier des défauts de surface micrométriques, figure 4.

Cependant, le champ de vision du micromap est limité à une surface de l’ordre de 0.5 x 0.5 mm2. Il y a peu, le micromap était déplacé manuellement à la surface des miroirs, et les défauts encore décomptés et caractérisés à l'œil.

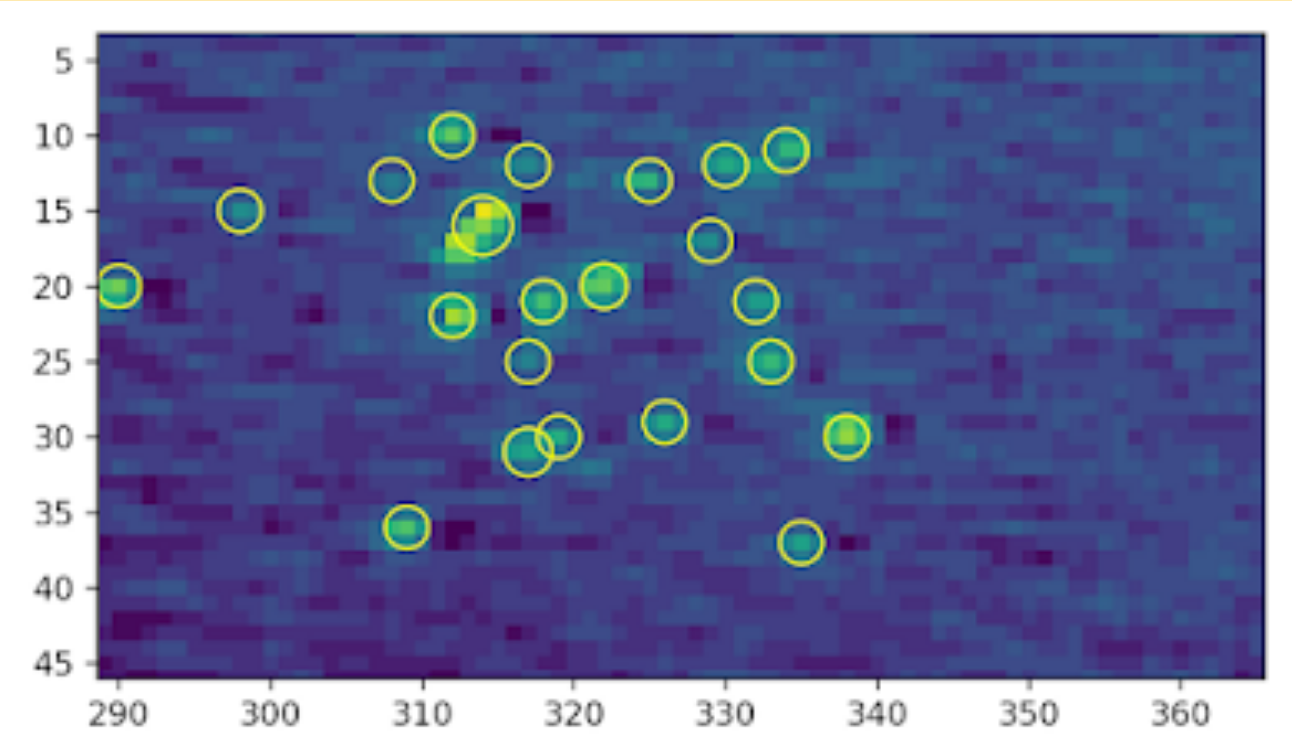

Un algorithme de vision par ordinateur non supervisé a été mis en place pour détecter les défauts automatiquement, figure 5 :

Cet algorithme permet de quantifier les défauts et de garantir que chaque miroir satisfait au cahier des charges avant son expédition. Il permet aussi d’adapter les paramètres de production pour les futurs miroirs.

Conclusion

Dans cette série de 3 articles, vous avez pu voir que l’IA n’est finalement qu’une branche de la modélisation statistique et découvrir quelques-unes de ses applications dans la recherche et l’industrie.

Vous avez également pu entraîner votre propre réseau de neurones pour reconnaître des images de chiffres manuscrits.

Pour en apprendre davantage sur l’IA : https://thedatafrog.com

Série de 3 articles : L'intelligence artificielle : introduction et applications en physique

Article 1/3 :« L'intelligence artificielle, c'est quoi ? - Une explication pour les physiciens ».

Références

[1] AlphaFold, vidéo de ScienceEtonnante https://www.youtube.com/watch?v=OGewxRMME8o

[2] Thèse de Lucas Torterotot, 2021, à paraître

[3] Laboratoire des Matériaux Avancés (CNRS/IN2P3) http://lma.in2p3.fr/

Pour citer cet article :

Quelques applications de l'intelligence artificielle - L'IA est en train de révolutionner la plupart des domaines scientifiques et industriels, voici quelques exemples, Colin Bernet, juillet 2021. CultureSciences Physique - ISSN 2554-876X, https://culturesciencesphysique.ens-lyon.fr/ressource/IA-Bernet-3.xml

![Vérification de la qualité de la surface d'un miroir au LMA [3].](https://culturesciencesphysique.ens-lyon.fr/images/articles/ia-bernet/LMA.png)